Uma plataforma gratuita capacitando IA local com modelos abertos

Ollama é uma plataforma de desenvolvimento e TI de código aberto gratuita que traz poderosos modelos de linguagem grandes para sua própria máquina, dando aos desenvolvedores e entusiastas de IA controle local sobre geração, resumo e tarefas de codificação. Com suporte multiplataforma e execução offline, visa equilibrar desempenho com privacidade, evitando dependências de nuvem.

Alternativa mais recomendada

Oferece muitas capacidades

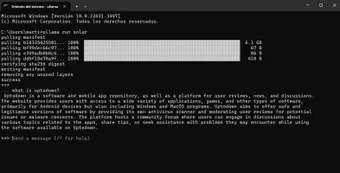

Ollama executa modelos de IA localmente, oferecendo acesso direto a uma extensa biblioteca de modelos pré-treinados. Possui ferramentas para interagir, alternar entre e integrar modelos em fluxos de trabalho. Sua interface de linha de comando é simples, e aplicativos oficiais recentes adicionam opções de GUI para conversar e gerenciar modelos de forma mais intuitiva.

Além disso, é flexível e garante privacidade, mantendo todos os cálculos no dispositivo e livres de custos recorrentes na nuvem. Os desenvolvedores também podem conectar esta plataforma a scripts de automação, aplicativos Python ou APIs graças ao suporte embutido. No entanto, alguns feedbacks da comunidade apontam preocupações ocasionais de estabilidade com lançamentos mais novos, sublinhando a importância de testes em ambientes de produção.

Uma forte opção de IA local

Ollama se destaca por capacitar usuários com execução de LLM no dispositivo, forte suporte multiplataforma e ricas possibilidades de integração. Sua natureza de código aberto e postura de privacidade são grandes conquistas para muitos, embora o uso avançado possa exigir familiaridade com ferramentas de linha de comando e configuração cuidadosa.